米テキサス州オースティンで毎年3月に開催されるビジネス・カンファレンス&フェスティバル「SXSW(サウス・バイ・サウスウエスト)」。1987年に音楽フェスティバルとして始まった同イベントは映画とインタラクティブが追加され、世界最大級の国際カンファレンスとして成長した。前半はテクノロジーを中心としたカンファレンスや展示会、後半はライブやコンテンツなどのフェスティバルという形で知られているが、近年はコンバージェンスというコンセプトの下、ジャンルの垣根なく交流してほしいというSXSW運営側の意図があり、期間もテーマもよりミックスされている。

3月9~18日まで米テキサス州オースティンで開催中のSXSW2018。インタラクティブの最終日である13日に、レイ・カーツワイル(Ray Kurzweil)氏が登壇した。人工知能研究の権威であり、フューチャリストとしてシンギュラリティ(技術的特異点)に関する著述で知られる。SXSWには、2012年、2017年と登壇し、今回が3回目となる。

講演は、米テックメディアサイト大手の「Mashable」のチーフ編集ジェシカ・コーエンとのインタビュー形式で行われた。カーツワイル氏は、SXSWでも重要なトピックとして挙げられている、AI(人工知能)、VR(仮想現実)/AR(拡張現実)、バイオテクノロジーといったさまざまな領域についての質問に答える形で未来のビジョンを語った。

私たちは生物学的な知性とそうではない知性とのハイブリッドになる

自身が予測した未来のうち86%がすでに完了しているという話題から始まった講演では、オーディエンスの一番の関心事であるAIについて早速質問が投げかけられた。カーツワイル氏は、200万年前から起こった人類の脳の進化について触れ、大脳新皮質が人類に知性をもたらしたこととAIの今後の進化を照らし合わせて説明した。

「言語、アート、音楽など、まさに“ヒューマニティー”をつかさどる脳の部分が進化したことによって、人間を人間たらしめ、地球上で比類ない進化をたどった。われわれ人間はもう一度それを再現します、つまりクラウド上に“合成新皮質“とも言えるものをつくるのです」と語り、私たち人間は本来の知性と人工的な知性のハイブリッドな存在になっていくという未来のビジョンを共有した。

続けて「重いコンピューターを持ち歩いていたけれど、今やポケットにデバイスを入れて持ち歩く時代です。さらに体の中にセンサーを入れるような時代になってくるでしょう。AIは脳の拡張装置です。脳も体も拡張されるといった私のシナリオがもう現実に起こっています」とも。

その一方で「AIをほかの惑星から来た侵略者として捉えるのではなく、自分たちをより良くスマートにするためのツールとして、主体的に捉え開発していくべきです」とも話した。

歴史的に見ても人類は今が一番幸福な時代

日本だけでなく世界的にも、AIの話題になると、必ずディストピアな未来像が描かれる。AIに支配された世界や、仕事が奪われていくという脅し文句……。メディアの報道や取り上げ方、映画などのコンテンツの力は大きい。それを踏まえて、カーツワイル氏が投げかけたのは、瞬間的にそのときだけを見るのではなくて、長いスパンで“人類”を見るべきだということ。

例えば、「この数世紀の間にたくさんのデモクラシーが起こり、洗練されてきました。これにより平和的に民主的な方向に進んでいます。バイオレンスや貧困、エネルギー効率も状況的には良くなり、識字率も今が一番高いです。人類を長いスパンで見ると、今が一番幸福な(ウェルビーイングな)時代です」と説明した。

「どうしても恐怖や悪い面のほうが関心を得やすい性質を持っているため、AIやITの議論に関してもマイナスな面がクローズアップされてしまう」というのがカーツワイル氏の考え方である。

「私は楽観主義者です」と言い、特にバイオテクノロジー、AR/VRやAIは、未来の明るい発展的な技術であることを主張した。

人工知能もバイアスを持つのか?

テクノロジーの明るい面を語りつつも、SXSW2018で大きなテーマの一つとなっている「バイアス(偏見)」の話題については深掘りされた。

SXSWでは3年ほど前から、差別や多様性についての議論が活発になっている。能力やスキルではなく、名前(男女の区別がつくため)や出身地、人種などでバイアスをかけて相手をどうしても判断してしまう。それをどうなくしていくかは根深い問題である。AIについても同じことが言えるのだろうか?

司会のジェシカ氏が、AIをプログラムするときに、プログラマーやクリエーターが知らないうちにバイアスを吹き込んでしまうのではないか? と質問すると、「AIは人間から学習する。これまで人間が残している膨大なドキュメントから学ぶため、必然的にバイアスを取り込んでしまう」と答えた。

例えば、私たちが外科医と聞くと男性医師を思い浮かべてしまうだろう。指摘されないとそのイメージがおかしいことだと意識できない。そういったことを一つひとつを正していくことが必要なのだ。複数ある価値観をいかにニュートラルな視点で、AIが返すことができるかが肝になってくる。

また、「新しい技術には膨大なレギュレーション(規制)が必要です」という指摘もあった。約40年前にバイオテクノロジーに関しての倫理的なガイドラインが議論されたアシロマ会議を引き合いに出し、「共通のレギュレーションの設定とアップデートが不可欠です」と主張した。未来も含めたAI開発の全体の歴史のなかで、現在はシンギュラリティを迎えるまでの重要な時代であることを再認識させられた講演だった。

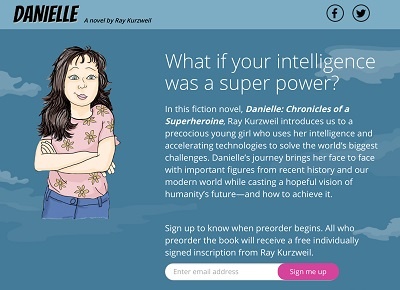

カーツワイル氏が描くスーパーヒロイン、ダニエル

カーツワイル氏は現在、小説『Danielle: Chronicles of a Superheroine(ダニエル:スーパーヒロイン物語)』を執筆中だ。発売時期は今年の夏以降だが、詳細は未定。物語は一人の女の子がその知性と勇気を使って、世界の問題と向き合い解決していこうとする話だそうだ。イントロダクションを読んだだけでも、前向きに今後の世界を考えられそうな内容である。

SXSWでも近年、ストーリーテリングの影響力について議論されることが多い。想像力をフルに使って紡ぎ出されたフィクション、または真実を伝えようとするドキュメンタリーなど、お話の形をした情報は単なる事象の羅列よりも、人の心に残りやすく影響をおよぼしやすい。

小説は、シンギュラリティという言葉が独り歩きしてしまっているように思える今、カーツワイル氏が楽観的に前向きに描く未来像を、どんな世代にも分かりやすく、たくさんの人に共感してもらうための、新しい挑戦の一つなのかもしれない。

最後に、会場からカーツワイル氏に以下のような質問があった。

「What will futurists do after the singularity?(シンギュラリティが起きた後、フューチャリストは何をするんですか?)」

答えは、「シンギュラリティが起きた後も未来は続くよ」。

2045年は人類にとって象徴的な出来事が起こるかもしれない。しかし、それは始まりに過ぎず、その後の世界がどうなっていくのか、どういう世界にしていきたいのか、未来像を具体的に描けるフューチャリストが、私たちには必要だと感じた講演だった。

(文/未来予報株式会社)